STRATEGIC PLANNING of a pure-race CYBER FACTORY

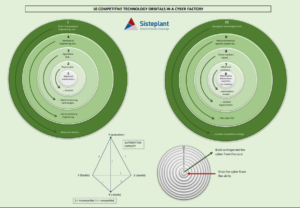

10 Competitive Technology Orbitals in a Cyber Factory

SHARE ON

En 1935 Erwin Schrödinger planteó su famosa paradoja del gato para explicar el principio de superposición de la física cuántica, que explica que un sistema físico existe en todos sus posibles estados simultáneamente y que, solo cuando es medido u observado, adopta uno de dichos estados. El experimento que ideó Schrödinger para hacerlo comprensible consiste en introducir a un gato en una caja hermética con una ampolla de gas letal en su interior, que puede romperse en cualquier instante. Mientras la caja está cerrada, nadie sabe si la ampolla se ha roto o no, y por tanto si el gato está vivo o muerto. Ahora bien, según el fenómeno de la superposición, el animal está a la vez vivo y muerto y adopta uno de estos estados cuando se abre la caja y lo observamos. Es decir, la observación determina el estado concreto del gato: vivo o muerto. La paradoja del gato de Schrödinger sugiere que, dependiendo de cómo observemos la realidad, ésta adoptará un estado u otro. Y traído al desarrollo acelerado de la Inteligencia Artificial (IA) y de las nuevas tecnologías, podríamos afirmar que nuestra observación condicionará su uso positivo o negativo para la humanidad. ¿Sobreviviremos o no a la tecnología?

Existen dos actitudes de observación. La primera es la de una resignación determinista según la cual nada se puede hacer para evitar que la tecnología nos domine en un futuro no tan lejano. La segunda es la de una acción proactiva que sostiene que la tecnología permitirá incrementar las capacidades físicas, sensitivas y cognitivas de las personas, y que estará sometida a la voluntad humana. La primera confirmaría que el ser humano es tan estúpido como para crear tecnología que inevitablemente le extinguirá o le someterá a un nuevo modo de esclavismo. La segunda dibujaría un escenario en el que el mundo mejora para las personas y su entorno, en el cual el balance entre estupidez y listeza resulta favorable para la listeza. Considerando que la única actitud válida es la segunda, atendiendo a razones éticas, a un sentimiento de responsabilidad con las futuras generaciones y, por qué no, al instinto de supervivencia, ¿qué podemos hacer en nuestras organizaciones para convertir esta actitud en hechos concretos?

En 2018 Sisteplant presentó el modelo Human 4.0 de transformación de las organizaciones y el desarrollo de sus personas, en sincronización con la disrupción y adopción de las nuevas tecnologías. El modelo situaba el foco de la transformación en las personas, como verdaderos motores del cambio cultural y de la explotación eficiente, sostenible, ética y responsable de las nuevas tecnologías.

Este modelo, ahora llamado Human ∞.0, sigue vigente y sus mensajes fundamentales se hacen más necesarios aún:

Lo anterior establece un marco de actuación para las empresas, que promueve que éstas configuren sus estrategias y tácticas hacia el desarrollo de las capacidades de las personas, utilizando la tecnología como un instrumento, no como un fin, de una forma ética y responsable. Este marco no es suficiente y debe ser reforzado por un marco regulatorio elaborado por los gobiernos, que tenga un trasfondo humanista y que incentive la utilización responsable de los avances tecnológicos, poniéndolos al servicio de la humanidad, y no en su perjuicio.

El auge de la IA General, que se refiere a la capacidad de los sistemas computacionales para generar nuevo conocimiento científico y desarrollar tareas como lo hacen los humanos conlleva riesgos evidentes: un ordenador superinteligente que aprende y se desarrolla de forma autónoma, que comprende su entorno sin necesidad de supervisión, que puede transformar e influir en el mundo que le rodea, que incluso puede generar autoconsciencia, autoconciencia y, por tanto, capacidad de autodefensa, podría definir el comienzo de la obsolescencia o destrucción de la raza humana. Pero este riesgo se puede controlar y minimizar si el marco regulatorio promueve la inversión en el avance de la disciplina de Alineamiento de la IA, que consiste en el diseño de métodos de direccionamiento del desarrollo de los sistemas de IA conforme a los valores humanos. Un sistema puede ser técnicamente capaz, pero no alineado, cuando su comportamiento y objetivos no han sido previstos y/o deseados por sus desarrolladores, provocan efectos colaterales o generan consecuencias no planificadas en escenarios no contemplados inicialmente. El Alineamiento de la IA es la disciplina que actúa como contrapeso al puro desarrollo técnico de capacidades de las máquinas, sometiendo a éstas a un comportamiento moral determinado por las personas.

Podemos elegir entre vivir en una nueva Edad Media altamente tecnológica, en la cual cederemos la iniciativa intelectual a las máquinas, iniciando un camino de autodestrucción con difícil marcha atrás; o podemos elegir vivir en un nuevo Renacimiento en el que la tecnología incrementa las capacidades de las personas y genera un bienestar social y humano sin precedentes. Todo está en nuestras manos y todo está en nuestras decisiones de hoy. La aplicación de modelos de transformación empresarial como Human ∞.0 y un marco regulatorio humanista que estimule un desarrollo tecnológico alineado con los valores humanos habilitan la esperanza. No tenemos excusas. Observemos al gato vivo.

10 Competitive Technology Orbitals in a Cyber Factory

10 Competitive Technology Orbitals in a Cyber Factory

10 Competitive Technology Orbitals in a Cyber Factory

This website uses cookies so that we can provide you with the best user experience possible. Cookie information is stored in your browser and performs functions such as recognising you when you return to our website and helping our team to understand which sections of the website you find most interesting and useful.

Strictly Necessary Cookie should be enabled at all times so that we can save your preferences for cookie settings.

If you disable this cookie, we will not be able to save your preferences. This means that every time you visit this website you will need to enable or disable cookies again.

This website uses Google Analytics to collect anonymous information such as the number of visitors to the site, and the most popular pages.

Keeping this cookie enabled helps us to improve our website.

Please enable Strictly Necessary Cookies first so that we can save your preferences!

More information about our Cookie Policy