Prof. Diego Galar, VP Tecnología Sisteplant

La industria química es uno de los sectores más exigentes en cuanto a precisión, seguridad y control de calidad.

En este contexto, la automatización en la industria química y el uso de robótica en procesos químicos están revolucionando la forma en que las plantas operan. Gracias a estas tecnologías, las empresas pueden mejorar la eficiencia operativa, reducir riesgos y adaptarse a un mercado cada vez más competitivo.

En este sentido, la robótica y la automatización en la industria química ya no son una opción, sino una necesidad para mantener la competitividad, garantizar la seguridad y alcanzar niveles óptimos de eficiencia. De este modo, las empresas que adopten estas tecnologías no solo mejorarán sus resultados, sino que también estarán preparadas para los desafíos del futuro tecnológico.

El instante invisible en el que dejamos de entender la planta

Hay algo profundamente inquietante en una planta industrial que funciona exactamente como debería. Todo está en orden, las variables dentro de límites, los sistemas responden con normalidad y no hay señales evidentes de degradación. Desde fuera —y también desde dentro— todo sugiere que el sistema está bajo control.

Y, sin embargo, es precisamente en ese contexto donde comienza el verdadero riesgo. Existe un punto, silencioso y prácticamente imposible de identificar, en el que el sistema deja de ser plenamente comprendido por quienes lo operan. No está asociado a un fallo ni a un evento concreto, sino a un desplazamiento sutil en la relación entre el activo y el conocimiento que tenemos sobre él. Las plantas no fallan cuando algo se rompe, fallan mucho antes: cuando dejamos de entender lo que está ocurriendo.

A partir de ese momento, la planta sigue funcionando, pero deja de ser transparente. Lo que se degrada no es inicialmente su condición física, sino nuestra capacidad para interpretarla. El operador continúa observando, midiendo y registrando, pero lo que ve ya no representa completamente la realidad. La conexión entre percepción y sistema se debilita de forma progresiva, casi imperceptible.

Es ahí donde aparece la paradoja más peligrosa de la operación industrial moderna: cuanto más estable parece el sistema, más fácil es que dejemos de entenderlo.

La industria química ha convivido con esta tensión durante décadas, no por falta de rigor, sino por una limitación estructural del modelo de inspección. Inspeccionar ha significado observar de forma puntual un sistema que, por naturaleza, es continuo. Se han tomado decisiones críticas a partir de instantáneas de procesos que no se detienen, que evolucionan y acumulan degradación incluso cuando no es visible.

Este enfoque introduce un desfase inevitable entre la dinámica real del activo y la información disponible para gestionarlo. Durante años ha sido tolerable, pero en entornos cada vez más complejos y exigentes se ha convertido en una vulnerabilidad crítica.

Porque cuando la observación es discreta y el fenómeno es continuo, el fallo no aparece de repente. Se construye en silencio, precisamente mientras creemos que todo está bajo control.

El modelo humano de inspección: una solución que ha llegado a su límite

Durante décadas, la industria ha confiado en una figura casi invisible pero absolutamente crítica: el técnico que camina la planta. No aparece en los modelos ni en los balances, pero sostiene el sistema con algo difícil de formalizar: experiencia, intuición y memoria acumulada. Es quien detecta lo que no está instrumentado, quien percibe desviaciones antes de que sean evidentes y quien interpreta lo que no “encaja” cuando los datos no lo muestran.

Este modelo ha sido extraordinariamente eficaz, no tanto por su precisión como por su capacidad de adaptación. Allí donde los sistemas eran rígidos, el humano era flexible. Durante años, la industria ha funcionado porque alguien era capaz de interpretar lo que no estaba medido.

Pero ese equilibrio ha cambiado. No porque el técnico haya perdido capacidad, sino porque el sistema ha superado el rango en el que esa capacidad era suficiente.

El modelo humano de inspección tiene límites que no son circunstanciales, sino estructurales. El primero es físico: ningún operador puede abarcar completamente un sistema distribuido y complejo. Las plantas no son máquinas compactas, sino entornos extensos e interconectados donde siempre hay zonas que no se observan con la frecuencia necesaria. La inspección humana es, en el mejor de los casos, una aproximación parcial.

A esta limitación se suma una barrera más determinante: la cognitiva. El cerebro humano no está diseñado para procesar simultáneamente múltiples variables distribuidas en el espacio y en el tiempo, ni para detectar correlaciones débiles en entornos ruidosos. Es excelente identificando patrones evidentes, pero limitado cuando lo relevante es difuso o apenas perceptible. Y en mantenimiento industrial, lo importante rara vez es evidente.

La degradación no se anuncia, se insinúa. Evoluciona en un rango donde la experiencia deja de ser suficiente y la percepción deja de ser fiable. Es en ese territorio —lo incipiente, lo progresivo— donde el modelo humano empieza a fallar.

A esto se añade un tercer límite, el estadístico. El humano está preparado para reaccionar ante eventos, pero no para anticipar procesos. Detecta lo que ocurre, pero no necesariamente lo que está empezando a ocurrir. Y sin embargo, los fallos en sistemas complejos no emergen como eventos, sino como trayectorias de degradación que se desarrollan en el tiempo.

En ese contexto, confiar exclusivamente en la inspección humana es equivalente a intentar entender una película a partir de fotogramas aislados. Durante años ha sido suficiente, pero en entornos donde la seguridad, la disponibilidad y la eficiencia son críticas, esa incertidumbre deja de ser aceptable.

Aquí se produce la verdadera ruptura. No estamos ante una mejora incremental, sino ante el final de un paradigma. El humano no desaparece, pero deja de ser el centro del sistema de percepción. Y esta transición —más que tecnológica— es cultural, porque implica aceptar que hay partes del sistema que ya no podemos ver, aunque sigamos mirando.

“La inspección humana ilumina partes del sistema. El resto permanece fuera de campo.”

El fallo como proceso: una realidad que exige otro tipo de observador

Uno de los errores más persistentes —y más peligrosos— en la cultura industrial es la forma en la que conceptualizamos el fallo. Lo imaginamos como un instante: una ruptura, una fuga, una parada. Algo que ocurre de forma súbita y que, a partir de ese momento, puede ser analizado y corregido.

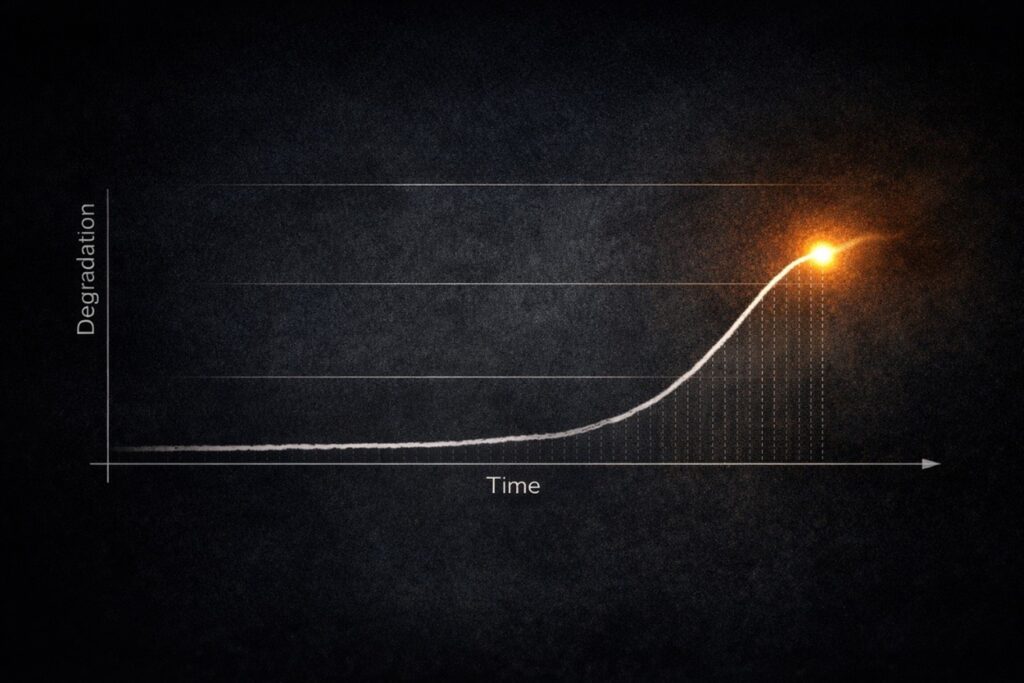

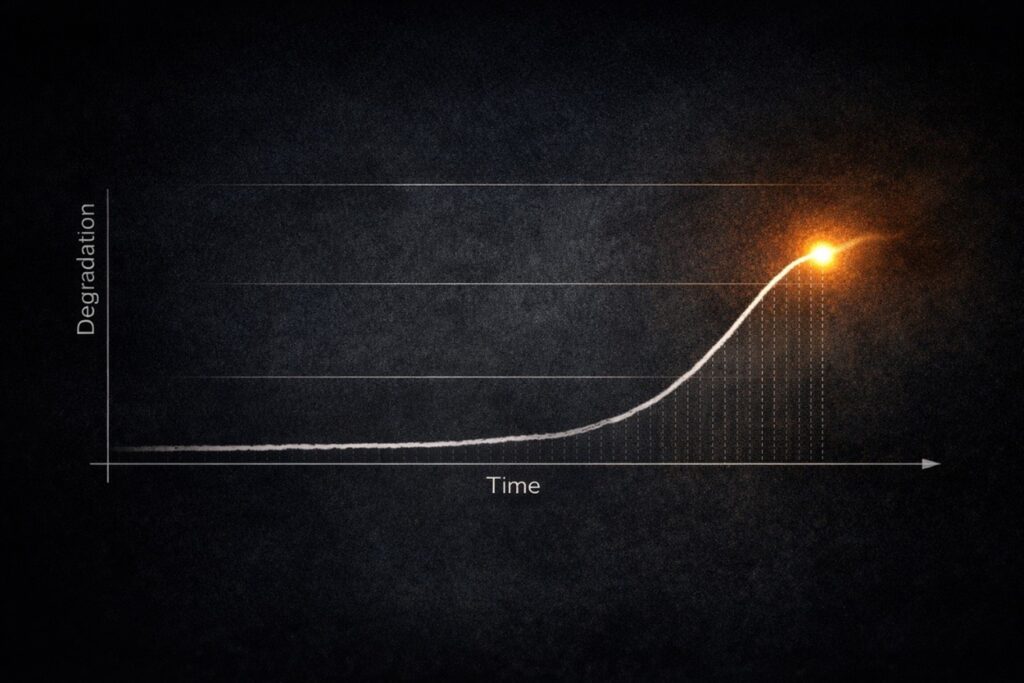

Es una narrativa cómoda, pero profundamente incorrecta. Ningún sistema complejo falla de forma instantánea. Lo que llamamos “fallo” no es más que el momento en el que un proceso de degradación acumulada alcanza un umbral crítico. El fallo no ocurre, emerge. Y cuando emerge, lo que vemos no es el inicio del problema, sino su fase final.

La corrosión, la fatiga o la degradación no son eventos, sino trayectorias. Procesos que evolucionan en el tiempo, acumulando efectos que rara vez observamos de forma continua. En ese sentido, el fallo es la manifestación visible de una historia que casi nunca hemos seguido completa.

“El fallo no empieza aquí. Aquí es donde finalmente somos capaces de verlo.”

Este desajuste entre la naturaleza del fenómeno —continuo— y la forma en la que lo observamos —discreta— es el origen de gran parte de las ineficiencias y riesgos en mantenimiento. Observar un proceso continuo mediante inspecciones puntuales implica aceptar que la mayor parte de la historia ocurre fuera de nuestro campo de visión. En la práctica, significa operar a ciegas gran parte del tiempo.

Es como intentar entender la evolución de un sistema dinámico observándolo en intervalos aislados. Cuando aparece una señal clara, el proceso ya ha avanzado demasiado.

Este cambio de perspectiva transforma la naturaleza de la inspección. Deja de ser una actividad de verificación para convertirse en un proceso de seguimiento. Deja de buscar eventos evidentes para centrarse en la evolución de patrones. Y deja de reaccionar a lo que ocurre para intentar anticipar lo que inevitablemente ocurrirá si no se interviene.

Pero seguir un proceso requiere observarlo en su propia escala temporal. Requiere continuidad. No basta con estar presente en momentos concretos; es necesario registrar, comparar e interpretar sin interrupción. Se necesita un observador que no opere en instantes, sino en flujos. Que no dependa de la memoria, sino del registro completo. Que no detecte eventos, sino trayectorias.

Y ese tipo de observador no puede ser humano. No por falta de capacidad, sino porque el problema ha dejado de estar en el dominio de lo humano.

Robots como sistemas de percepción: la construcción de una nueva realidad operativa

Durante años, la robótica industrial se ha entendido desde una lógica esencialmente mecánica: automatizar aquello que el humano ya hacía, pero con mayor precisión, sin fatiga y con menor exposición al riesgo. Bajo esa visión, el robot ha sido una prolongación del cuerpo humano, una herramienta avanzada capaz de ejecutar tareas repetitivas con mayor fiabilidad, pero siempre subordinada a la lógica definida por el operador.

Sin embargo, esta interpretación resulta hoy insuficiente. Lo que está ocurriendo no es una mejora en la capacidad de ejecución, sino un cambio en la naturaleza del sistema: el paso de máquinas que actúan a sistemas que perciben. Este no es un cambio tecnológico. Es un cambio en quién percibe la realidad del sistema.

Y en el momento en que un sistema percibe mejor que nosotros, deja de ser una herramienta para empezar a redefinir quién entiende realmente la planta.

El valor de los robots ya no reside en su capacidad de intervenir, sino en su capacidad de construir conocimiento sobre el estado del activo. No son simplemente plataformas que transportan sensores, sino sistemas de percepción capaces de capturar múltiples dimensiones de la realidad física. Allí donde el humano observa fundamentalmente en el espectro visible, el robot accede a capas de información que permanecen ocultas: distribuciones térmicas, firmas acústicas, concentraciones de gases o patrones vibracionales que anticipan comportamientos no evidentes.

Pero más importante que lo que observan es cómo lo hacen. El robot no observa de forma puntual, sino continua, sistemática y reproducible. No depende de la memoria ni de la interpretación subjetiva, sino del registro y la correlación constante. Esta continuidad transforma la naturaleza de la inspección, que deja de basarse en verificaciones discretas para convertirse en un proceso permanente de construcción de conocimiento.

“El robot no observa lo mismo que el humano. Observa más dimensiones de la realidad.”

En este contexto, inspeccionar deja de ser comprobar el estado en un instante para pasar a entender su evolución en el tiempo. La inspección deja de ser una fotografía y se convierte en una narrativa continua del comportamiento del activo. Y con ello, cambia también la naturaleza del conocimiento: de estático a dinámico, de puntual a continuo.

Este cambio desplaza el foco desde el estado hacia la dinámica. Ya no se trata de saber cómo está el activo, sino hacia dónde se dirige. La pregunta deja de ser “¿hay un problema?” para convertirse en “¿qué trayectoria está siguiendo este sistema y cuándo será inevitable el fallo si no se interviene?”.

En ese punto, el robot deja de ser una herramienta y se convierte en un sistema de percepción distribuida. No observa para informar, sino para construir una representación operativa del sistema, continuamente actualizada e integrada. Lo que emerge no es solo una mejora en la inspección, sino una nueva capa de realidad en la planta: una realidad digital, sensorizada y dinámica, que empieza a ser más precisa y accionable que la percepción humana directa.

Y es precisamente en la coexistencia entre lo que vemos y lo que el sistema percibe donde se define el nuevo paradigma operativo.

La ilusión del dato: por qué más información no implica más conocimiento

Si hay una transformación que define el estado actual de la industria, no es tanto la automatización de la acción como la expansión masiva de la capacidad de observación. En apenas una década, la inspección ha pasado de ser una actividad puntual, limitada por la disponibilidad de recursos humanos y accesibilidad física, a convertirse en un proceso potencialmente continuo, alimentado por una red creciente de sensores, plataformas móviles y sistemas digitales capaces de capturar información en múltiples dimensiones y a distintas escalas temporales. La planta, que antes era recorrida, hoy es medida; lo que antes se intuía, ahora se registra; lo que antes dependía de la memoria, hoy se almacena.

Sin embargo, esta evolución ha traído consigo una paradoja que no siempre se reconoce de forma explícita: la disponibilidad de más información no ha implicado necesariamente una mejora proporcional en la comprensión del sistema. De hecho, en muchos casos, ha ocurrido lo contrario. A medida que aumenta la cantidad de datos, aumenta también la dificultad para interpretarlos, para integrarlos en una visión coherente del activo y, sobre todo, para traducirlos en decisiones operativas que tengan un impacto real sobre la fiabilidad, la seguridad o la disponibilidad.

Esta situación revela una de las ilusiones más arraigadas en la narrativa de la digitalización industrial, que es la suposición implícita de que el dato contiene en sí mismo el conocimiento. En realidad, el dato sin contexto no solo no informa, sino que puede inducir a error con una precisión engañosa. Bajo esta lógica, medir más equivale a saber más, y saber más equivale a controlar mejor. Pero esta equivalencia, que resulta intuitiva, es conceptualmente incorrecta. El dato, por sí solo, no explica nada; es simplemente una representación parcial y aislada de un fenómeno físico en un instante determinado, una señal que carece de significado si no se inserta en un contexto más amplio que permita interpretarla.

El problema, por tanto, no reside en la capacidad de capturar información, que hoy es extraordinaria, sino en la ausencia de marcos que permitan convertir esa información en conocimiento operativo. Durante años se ha producido una inversión significativa en tecnologías de adquisición de datos —sensores más precisos, sistemas más conectados, robots más capaces— sin una evolución equivalente en los modelos que deberían dar sentido a esos datos. El resultado es un ecosistema donde la información existe en abundancia, pero no necesariamente en forma utilizable.

En este contexto, el dato deja de ser una solución y pasa a formar parte del problema, no porque carezca de valor, sino porque su valor depende completamente de la estructura interpretativa en la que se inserta. Sin un modelo que describa cómo debería comportarse el sistema, es imposible evaluar si lo que se observa es normal o anómalo; sin una referencia clara de degradación, no se puede determinar si una señal es un precursor de fallo o una fluctuación inocua; sin una conexión directa con la toma de decisiones, la información se convierte en un fin en sí misma, desvinculada de la acción.

La verdadera cuestión, por tanto, no es cuántos datos somos capaces de generar, ni siquiera cuán sofisticados son los medios para capturarlos, sino hasta qué punto somos capaces de utilizarlos para anticipar comportamientos futuros del sistema y actuar antes de que la degradación alcance un estado crítico. Es en ese punto donde se define el valor real de la inspección, no en la observación retrospectiva de lo que ya ha ocurrido, sino en la capacidad de intervenir sobre lo que todavía no se ha manifestado.

En última instancia, el conocimiento no surge de la acumulación de información, sino de la capacidad de organizarla, interpretarla y vincularla con decisiones que modifiquen el curso del sistema. Y mientras esa transición no se produzca de manera efectiva, la industria seguirá enfrentándose a una paradoja incómoda: disponer de más datos que nunca y, al mismo tiempo, no entender completamente lo que está ocurriendo.

El verdadero sistema: robótica, analítica y decisión integrada

La robótica, entendida de forma aislada, no soluciona el problema. Lo desplaza. Y a menudo lo hace más opaco, generando la ilusión de avance sin cambiar realmente la forma de decidir. La mayoría de iniciativas no fallan por la tecnología, sino porque nadie ha definido qué decisión debe cambiar.

Observar no tiene valor si no existe una estructura que transforme esa observación en conocimiento y, sobre todo, en decisión. El robot puede capturar información con una resolución y frecuencia inalcanzables para el humano, pero si esa información no se integra en un sistema que la procese, la interprete y la conecte con la acción, su impacto será necesariamente limitado.

Lo que emerge no es una solución puntual, sino la necesidad de un sistema integrado. En él, el robot actúa como nodo de adquisición distribuida, los algoritmos como mecanismos de interpretación y la organización como responsable última de transformar ese conocimiento en decisiones.

“El valor no está en el robot, sino en el sistema que transforma percepción en decisión.”

La clave no está en cada elemento por separado, sino en la coherencia del conjunto. Un robot sin analítica genera datos sin significado; una analítica sin contexto produce resultados difíciles de interpretar; y una organización sin mecanismos claros de decisión convierte el conocimiento en información inerte.

La conexión más crítica —y frecuentemente más débil— es la que une percepción y decisión. Traducir lo que el sistema observa en acciones concretas implica priorizar señales, gestionar recursos y evaluar riesgos en un entorno dinámico. En ese punto, la inspección deja de ser una actividad técnica para convertirse en un proceso de gestión del riesgo basado en información. Cuando esta conexión no existe, la robótica se queda en ejercicio tecnológico sin impacto operativo.

Sin decisión, no hay sistema. Solo hay datos. El verdadero cambio, por tanto, no es introducir robots en la planta, sino transformar la planta en un sistema capaz de observarse, interpretarse y actuar sobre sí mismo. Y eso solo es posible cuando robótica, analítica y decisión dejan de ser elementos independientes y pasan a formar parte de un único sistema integrado.

Confianza, responsabilidad y el nuevo paradigma operativo

A medida que los sistemas robóticos evolucionan desde plataformas de adquisición de datos hacia sistemas capaces de interpretar, recomendar e incluso actuar, emerge una cuestión que trasciende lo tecnológico y se sitúa en el núcleo de la operación industrial: la confianza. No se trata de una confianza abstracta, sino operativa, aquella que determina si una organización está dispuesta a basar decisiones críticas en sistemas que no son humanos.

Este desplazamiento no es trivial, porque cuestiona una de las bases más arraigadas de la cultura industrial: el juicio humano como garante final de la decisión. Durante décadas, incluso en entornos automatizados, siempre ha existido una figura que validaba lo que el sistema proponía. Ese modelo partía de una premisa clara: que el humano era el elemento más fiable del sistema.

Hoy esa premisa empieza a romperse. No desde la teoría, sino desde la práctica. En determinados contextos, los sistemas observan más, registran mejor y detectan patrones que escapan a la percepción humana, no por ser más “inteligentes”, sino porque operan en una escala que el humano no puede abarcar. Esto genera una tensión inevitable: el sistema puede entender mejor el estado del activo, pero la responsabilidad sigue recayendo en el operador.

Aceptar esta asimetría implica redefinir el rol humano. El operador deja de ser el principal observador para convertirse en un gestor de decisiones basado en información generada por sistemas autónomos. La decisión deja de ser un acto individual para convertirse en una interacción entre capacidades humanas y sistemas.

Este cambio abre una cuestión crítica: la responsabilidad. ¿Quién responde cuando una decisión basada en un sistema autónomo resulta incorrecta? Los modelos tradicionales no están preparados para una toma de decisiones distribuida, lo que obliga a desarrollar nuevos marcos de validación, certificación y control.

No basta con que el sistema funcione; es necesario demostrar que lo hace de forma fiable y dentro de márgenes de riesgo aceptables. Pero incluso con estos mecanismos, persiste una barrera más profunda: la aceptación cultural de que, en determinados escenarios, el sistema puede conocer mejor el estado del activo que el propio operador.

No se trata de sustituir al humano, sino de aceptar que su papel cambia. El conocimiento deja de ser exclusivamente humano, y la experiencia ya no se basa solo en lo vivido, sino también en lo que el sistema es capaz de inferir.

En este nuevo paradigma, la confianza deja de ser una cuestión de fe en la tecnología para convertirse en una construcción basada en evidencia. Y es precisamente cuando esa confianza se consolida —cuando el sistema demuestra de forma consistente su fiabilidad— cuando el cambio deja de ser potencial y se vuelve irreversible.

Hacia la planta que se observa a sí misma

Si algo queda claro es que la robótica en la industria química no puede seguir interpretándose como una capa adicional de tecnología ni como una mejora incremental. Lo que está ocurriendo es más profundo: la evolución hacia un sistema en el que la capacidad de observación deja de ser externa y episódica para convertirse en una propiedad intrínseca del propio activo.

Durante décadas, la percepción ha sido una actividad separada de la operación, dependiente de la intervención humana o de instrumentación puntual, generando una visión fragmentada del sistema. La planta ha operado siempre con un cierto desfase entre lo que ocurre y lo que somos capaces de conocer, un desfase que ha sido tolerable, pero que en entornos cada vez más complejos deja de ser sostenible.

Lo que emerge es un escenario distinto, donde la observación deja de ser puntual para convertirse en un flujo continuo de información. La degradación no se detecta cuando es crítica, sino que se sigue en su evolución, se interpreta dinámicamente y se gestiona de forma anticipada. La información deja de ser un registro del pasado para convertirse en una representación actualizada del comportamiento del sistema.

Este cambio desplaza el foco desde la reacción hacia la comprensión continua. Las decisiones ya no se basan en observaciones aisladas, sino en conocimiento dinámico que permite intervenir antes de que el fallo se materialice. El mantenimiento deja de ser una respuesta y se convierte en una gestión consciente de la degradación.

En este contexto, el robot deja de ser un elemento añadido y pasa a formar parte de la infraestructura cognitiva del activo. No actúa de forma aislada, sino que contribuye a un sistema en el que percepción, análisis y decisión forman un flujo único. El resultado no es solo una planta más automatizada, sino una planta cualitativamente distinta, capaz de reducir la incertidumbre y gestionar con mayor precisión su propio comportamiento.

La transformación no consiste en incorporar tecnologías de forma aislada, sino en construir un sistema que es capaz de observarse, interpretarse y actuar sobre sí mismo de manera coherente. Y es en ese punto donde el cambio deja de ser tecnológico para convertirse en estructural.

Porque cuando un sistema es capaz de conocerse mejor que quienes lo operan, la cuestión ya no es tecnológica. La cuestión es otra: si seguimos siendo nosotros quienes entendemos la planta… o si simplemente seguimos ahí mientras ella ya ha empezado a entenderse sola.